CVPR 2025|Tripo AI и Бэйханский университет представляют MIDI: генерация композиционных 3D-сцен из одного изображения

Эта работа выполнена исследователями из VAST, Бэйханского университета, Университета Цинхуа и Гонконгского университета. Первым автором является Цзэхуань Хуан, магистрант Бэйханского университета, чьи исследования сосредоточены на генеративном ИИ и 3D-зрении. Соответствующими авторами являются Яньпэй Цао, главный научный сотрудник VAST, и Лю Шэн, доцент Бэйханского университета.

В то время как Sora зажигает революцию в мировых моделях, 3D-сцены, являясь цифровой основой физического мира, становятся критически важной инфраструктурой для построения динамических и интерактивных систем ИИ. Текущие прорывы в генерации 3D-активов из отдельных изображений обеспечили базовую возможность "от воображения к 3D" для создания 3D-контента.

Однако, по мере развития технологий в сторону генерации композитных сцен, становятся очевидными ограничения парадигм генерации отдельных объектов. Существующие методы генерируют 3D-активы, как разрозненные "цифровые атомы", с трудом самоорганизующиеся в "молекулярные структуры" с разумными пространственными отношениями. Это приводит к нескольким основным проблемам: ① Дилемма разделения экземпляров (как точно отделить перекрывающиеся объекты от одного вида); ② Моделирование физических ограничений (как избежать нереалистичных пересечений и столкновений); ③ Семантическое понимание на уровне сцены (как поддерживать согласованность между функцией объекта и пространственным расположением). Эти узкие места серьезно препятствуют эффективному построению "интерактивных миров" из "цифровых атомов".

Недавно исследовательская группа из Бэйханского университета, VAST и других учреждений представила новую модель — MIDI, которая может генерировать высококачественные с точки зрения геометрии, разделяемые на экземпляры композитные 3D-сцены из одного изображения, достигая прорыва в генерации 3D-сцен из одного вида и закладывая основу для генерации интерактивных миров.

- Статья: https://arxiv.org/abs/2412.03558

- Страница проекта: https://huanngzh.github.io/MIDI-Page/

- Код: https://github.com/VAST-AI-Research/MIDI-3D

- Онлайн-демо: https://huggingface.co/spaces/VAST-AI/MIDI-3D

Технологический прорыв

Традиционные методы реконструкции композиционных 3D-сцен часто полагаются на многостадийную, пообъектную генерацию и оптимизацию сцены, что приводит к длительным процессам и часто генерирует сцены с низким геометрическим качеством и неточными пространственными расположениями. Для решения этих проблем MIDI (Multi-Instance Diffusion Model) инновационно использует модели генерации 3D-объектов, расширяя их до модели многоэкземплярной диффузии, способной одновременно генерировать несколько 3D-экземпляров с точными пространственными отношениями, достигая эффективной и высококачественной генерации 3D-сцен:

- От генерации одиночных объектов к генерации множественных экземпляров: Одновременно убирая шум из латентных представлений нескольких 3D-экземпляров и вводя взаимодействия между токенами нескольких экземпляров в процессе шумоподавления, MIDI расширяет модели генерации 3D-объектов, позволяя им одновременно генерировать несколько экземпляров с моделированием взаимодействия, которые затем напрямую объединяются в 3D-сцену.

- Механизм самовнимания для нескольких экземпляров: Расширяя механизм самовнимания моделей генерации объектов до самовнимания для нескольких экземпляров, MIDI эффективно улавливает пространственные корреляции между экземплярами и согласованность всей сцены в процессе генерации, устраняя необходимость в оптимизации каждой сцены.

- Аугментация данных во время обучения: Контролируя взаимодействие между 3D-экземплярами с использованием ограниченных данных сцены и одновременно дополняя обучение данными объектов, MIDI эффективно моделирует расположение сцены, сохраняя при этом обобщающие способности предварительного обучения.

Сгенерированные результаты

На основе одного изображения MIDI может генерировать высококачественные композиционные 3D-сцены:

Онлайн-демо

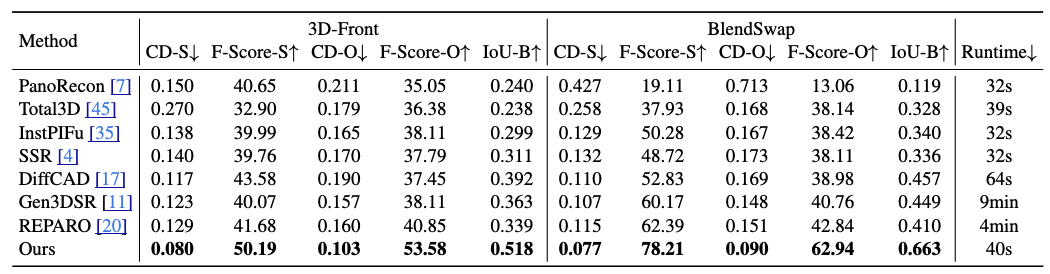

Превосходная производительность

MIDI характеризуется точным моделированием пространственного расположения, превосходным качеством генерации геометрии, эффективностью генерации и широкой применимостью. Экспериментальные результаты показывают, что модель превосходит существующие методы на нескольких наборах данных, достигая отличных результатов в пространственных отношениях 3D-экземпляров, геометрическом качестве 3D-экземпляров и сквозной скорости генерации.

Приложения: Новый инструмент для создания 3D-сцен

MIDI предлагает новое решение для создания 3D-сцен. Эта технология демонстрирует большой потенциал в различных областях, таких как архитектурный дизайн, виртуальная реальность, киноспецэффекты и разработка игр. Благодаря своим возможностям генерации высокоточных 3D-сцен с высоким геометрическим качеством, MIDI может удовлетворить спрос на высококачественный контент в сложных сценах, предлагая создателям больше возможностей.

Tripo: Генератор 3D-моделей на базе ИИ

Пока MIDI революционизирует композицию 3D-сцен, Tripo улучшает создание отдельных активов с помощью передовых возможностей ИИ:

Из одного изображения в 3D-модель

- Мгновенное преобразование одного 2D-изображения в высококачественную 3D-модель.

- Реконструкция на базе ИИ обеспечивает точную форму и текстуру.

- Идеально подходит для быстрого прототипирования и визуализации концепций.

Из нескольких изображений в 3D-модель

- Использование нескольких изображений с разных ракурсов для лучшей глубины и детализации.

- Повышает геометрическую точность и реализм.

- Идеально подходит для точного моделирования объектов и продуктового дизайна.

Из текста в 3D-модель

- Генерация 3D-моделей из простых текстовых описаний.

- ИИ интерпретирует подсказки для создания детализированных, креативных активов.

- Ускоряет генерацию концепций для игр, VR и анимации.

Автоматический риггинг и анимация

- Мгновенно риггует модели для анимации с минимальными усилиями.

- Генерация костной структуры и движения на основе ИИ.

- Делает модели готовыми к игре для бесшовной интеграции.

Будущая работа

Несмотря на отличную производительность модели, команда разработчиков MIDI признает, что еще есть много областей для улучшения и исследования. Например, дальнейшая оптимизация адаптивности к сложным интерактивным сценам и улучшение детализации генерации объектов являются ключевыми направлениями будущих усилий. Команда надеется, что благодаря постоянному совершенствованию и доработке это направление исследований не только будет способствовать развитию технологии генерации композитных 3D-сцен из одного вида, но и внесет вклад в широкое внедрение 3D-технологий в практических приложениях.

Advancing 3D generation to new heights

moving at the speed of creativity, achieving the depths of imagination.

Текст и изображения в 3D-модели

Текст и изображения в 3D-модели Бесплатные кредиты ежемесячно

Бесплатные кредиты ежемесячно Максимальная детализация

Максимальная детализация